32

Αποστολή Αιτημάτων στο API

Η llm_response είναι μία συνάρτηση μέσω της οποίας λαμβάνεται η απάντηση που

στέλνει το LLM στο χρήστη, με τη χρήση του URL από το api.py. Έπειτα μέσω των requests

και σε συνδυασμό με το post, στέλνεται ένα αίτημα, ώστε τα δεδομένα και το μήνυμα του

χρήστη να σταλεί στο server και να ληφθεί μία απάντηση. Η απάντηση αυτή καταχωρείται με

τη βοήθεια του json.

def llm_response(message):

url = "http://127.0.0.1:5010/take_a_response"

data = {'message': message}

print("message:", message)

response = requests.post(url, json=data)

response_json = response.json()

print("Response:", response_json['response'])

# return the llms response

return response_json['response']

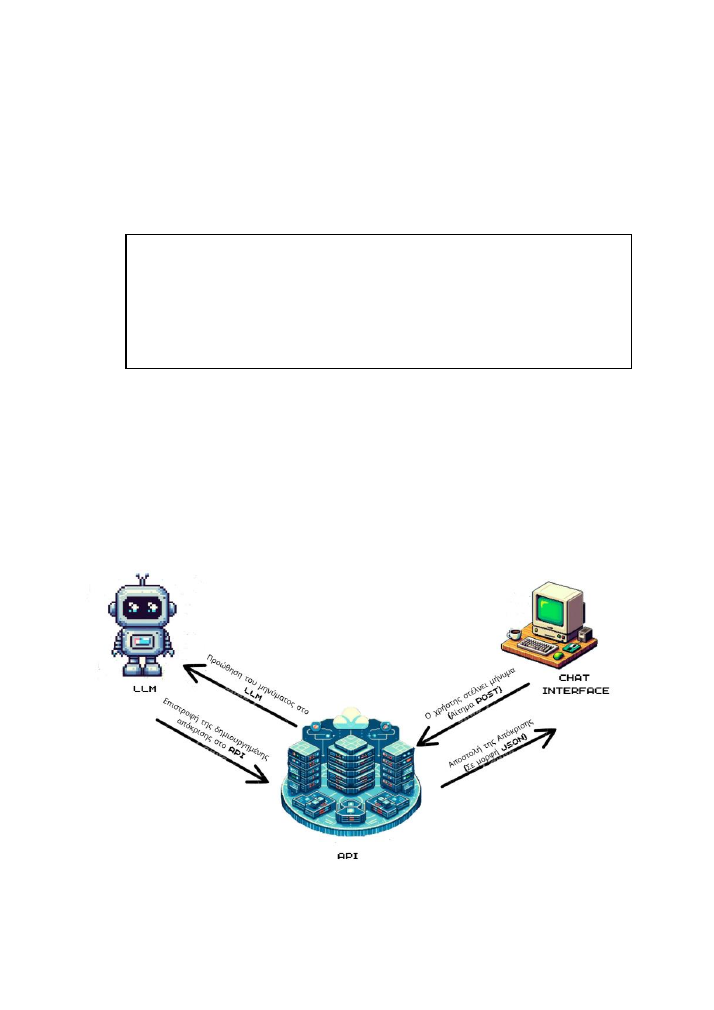

Η επικοινωνία μεταξύ της διεπαφής συνομιλίας και του LLM μέσω του API

ολοκληρώνεται με επιτυχία, παρέχοντας έναν διαδραστικό τρόπο για την αλληλεπίδραση του

χρήστη με το γλωσσικό μοντέλο.

Στην παρακάτω εικόνα, αναπαρίσταται η σύνδεση και η επικοινωνία του LLM με το

chat interface μέσω του API.

Εικόνα 21. Σύνδεση LLM και Chat μέσω API